ChatGPT의 사용법, 활용 예시에 관한 글은 많지만 ChatGPT라는 서비스가 어떻게 이렇게까지 선풍적인 인기를 끌 수 있었는지에 관한 분석은 많지 않은 것 같아 몇가지 포인트에서 생각해보았습니다. 원래는 동아리 토론용으로 작성한 글인데 버리기 아까워서 블로그에 올립니다. 읽으시는 분께서는 제 뇌피셜인 부분이 많으니 감안하시고 지적할 부분 댓글 남겨주시면 감사하겠습니다.

1. ChatGPT는 GPT-3에 RLHF를 적용하고 대화 데이터셋을 학습시켜 더 인간답고 자연스러운 답변을 내보낼 수 있다는 점에서 GPT-3와 구분됩니다.

- GPT-3과 ChatGPT의 기술적 차이

GPT-3와 ChatGPT의 기술적 기반은 비슷하지만, GPT-3에 비해 ChatGPT가 훨씬 폭발적인 반응을 이끌어냈습니다. 그 이유에 관하여 먼저 기술적 측면에서 분석해보고자 합니다.

ChatGPT에 관해 설명하는 논문이 공개된 바 없기 때문에, InstructGPT 논문을 통해 추측해볼 수밖에 없습니다. ChatGPT는 GPT-3.5를 기반으로 한 모델이며, InstructGPT와 같이 RLHF(Reinforcement Learning from Human Feedback)를 이용해 학습되었습니다. RLHF는 fine tuning 시에 사람의 피드백을 이용하도록 하는 강화 학습 방법입니다. 자세한 내용은 InstructGPT 논문, Deep Reinforcement Learning from Human Preferences (2017)에도 수록되어 있습니다. openai blog에 따르면, 그 구체적인 방법은 다음과 같습니다.

- 파인 튜닝 시에 인간 labeler가 만든 라벨을 사용

- output 여러 개를 생성하고 인간 labeler가 output이 좋은 것부터 순위를 매김, 이를 reward model training에 사용

- 생성한 reward model로 강화 학습하여 최적화

source: openai blog

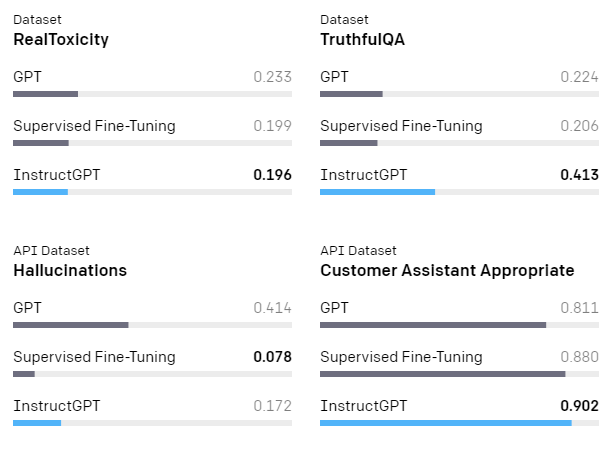

인간의 피드백을 사용하기 때문에 더 인간다운, 즉 인간이 보기에 그럴듯하고 자연스러운 답변을 생성할 수 있는 것입니다. 이 방법을 사용하여 학습시킨 결과는 다음과 같이 나타났다고 합니다.

source: openai blog

ChatGPT는 InstructGPT와 같은 기술이지만 데이터셋을 수집하는 방법을 달리하며 채팅 기능을 더 강화시켜 서비스화한 것으로 알려져 있습니다. 간략히 말하자면, 인간 Labeler가 user 및 AI assistant의 대화를 만들어낸 후 이를 대화 형식으로 변경한 InstructGPT dataset과 함께 사용한 것입니다.

2. ChatGPT는 안전성 문제와 논란에 관한 우려에 불구하고 과감하게 일반 대중을 대상으로 출시되었기에 성공할 수 있었습니다.

- Meta, Google의 AI와의 비교

다음은 워싱턴포스트 1월 27일 기사의 일부입니다. Collective[i]에서 주최한 포럼에서 Meta AI의 얀 르쿤은 Meta의 Blenderbot에 대해 “안전했기 때문에 지루했다”고 발언했습니다. 그는 잃을 게 많은 Google, Meta 등 빅테크 기업과 달리 OpenAI는 과감했기 때문에 ChatGPT가 성공할 수 있었다고 주장했습니다.

- “The reason it was boring was because it was made safe,” LeCun said last week at a forum hosted by AI consulting company Collective[i]. He blamed the tepid public response on Meta being “overly careful about content moderation,” like directing the chatbot to change the subject if a user asked about religion.

그의 말마따나, Google은 137B 파라미터들을 가지는 트랜스포머 기반의 pre-trained language model LaMDA를 일반 대중에 공개하지 않고 AI Test Kitchen에서 한정된 수의 AI 개발자들에게만 공개했습니다. 다음은 기사에 수록된 내용입니다.

- Market rumors claim that LaMDA was never released because the conversational platform of the AI chatbot did not work with Google’s current advertising strategy, which generated 81% of its income in FY2021.

- Since the AI chatbot has been known to mimic human speech from the internet and spread some types of hate speech, fake news, racist and sexist statements, and a high degree of informative inaccuracy, there may also be reputational hazards.

- The LaMDA AI platform is presently not accessible to the general public and is only accessible to a select number of AI developers via the AI Test Kitchen.

종합해 보면, ChatGPT와 맞먹을 수 있는 기술력을 보유한 Google, Meta 정도 사이즈의 빅테크 기업들은 Language Model의 Safety Hazard를 감수하기 어려워 과감하게 일반 대중을 상대로 하는 Conversational Language Model을 내놓기 어려웠다는 이야기입니다. 한편, ChatGPT의 자세한 훈련 방법은 알려져 있지 않지만, 어쨌든 Safety Issue를 꽤 잘 차단하는 동시에 흥미로운 Conversational Language Model을 내놓은 것이 성공 비결인 것으로 보입니다.

3. ChatGPT는 대화를 주고받는 챗봇 기능뿐 아니라, 누구나 새로운 콘텐츠(텍스트 형태)를 생성할 수 있는 창작 툴로서의 기능을 강조한 덕분에 논란을 피하고 다양한 사용자층을 끌어들일 수 있었습니다.

- 콘텐츠 창작 툴로서의 ChatGPT

ChatGPT는 일상 대화를 주고받는 것이나 질문에 대답해주는 것을 넘어 새로운 ‘콘텐츠’를 창작할 수 있는 언어 모델이며, openai의 마케팅도 그러한 측면을 강조했습니다.

다음은 워싱턴포스트 1월 27일 기사의 일부입니다.

- Text generators like Google’s LaMDA and the chatbot start-up Character.ai can carry on casual conversations. Image generators like Lensa, Stable Diffusion and OpenAI’s DALL-E can create award-winning art. And programming-language generators like GitHub Copilot, a tool built on OpenAI technology, can translate people’s basic instructions into functional computer code.

- But ChatGPT has become a viral sensation due in large part to OpenAI’s marketing and the uncanny inventiveness of its prose. OpenAI has suggested that not only can the AI answer questions but it can also help plan a 10-year-old’s birthday party. People have used it to write scenes from “Seinfeld,” play word games and explain in the style of a Bible verse how to remove a peanut butter sandwich from a VCR.

기사에 나오지 않는 Meta의 Blenderbot도 대화를 주고받고 질문에 답변하는 기능에 집중된 마케팅을 펼쳤습니다.

반면, openai에서는 ChatGPT를 단순히 대화를 주고받는 챗봇의 기능뿐 아니라, 새로운 콘텐츠를 제작하는 툴로 포지셔닝했습니다. 또한, 전문 지식을 요구하는 분야 대신 일반 대중을 타겟팅했습니다. 이 덕분에 bias, hallucination에 관한 논란을 피하기에 좋았습니다.

다음은 Harvard Business Review 2022년 12월 기사 내용 중 일부입니다. 일반 대중의 창작 행위에 사용되도록 타겟팅했기에 오히려 AI의 잘못된 동작에 따르는 위험이 적고 용인 가능했다는 이야기입니다.

- Until now, AI has primarily been aimed at problems where failure is expensive, not at tasks where occasional failure is cheap and acceptable — or even ones in which experts can easily separate failed cases from successful ones. A car that occasionally gets into accidents is intolerable. But an AI artist that draws some great pictures, but also some bad ones, is perfectly acceptable. Applying AI to the creative and expressive tasks (writing marketing copy) rather than dangerous and repetitive ones (driving a forklift) opens a new world of applications.

Dalle의 경우와 마찬가지로, 창작 행위에서의 AI의 잘못된 동작은 Meme화 되기에 좋고 일종의 재밌거리로 작용할 수도 있다고 생각합니다. 마케팅에 도움이 될 수도 있다고 생각합니다. 상식적인 이야기지만, Principle Differences between B2B and B2C Marketing Communication Processes (2019) 논문에 따르면 B2C 마케팅에서는 제품의 실제 성능에 관한 정보 제공보다도 소비자의 감정을 자극하고 이목을 끄는 것이 중요합니다. ChatGPT에는 AI의 이상한 동작을 발견하여 유머로 사용한다던가, 신기하고 새로운 prompt를 발굴하는 등 재미 요소가 많다고 생각합니다.

또한, ChatGPT는 개별 대화의 맥락을 기억하며 인간의 교정 요구에 적절히 응답할 수 있다는 점에서 창작 행위에서의 좋은 협업 도구 및 개인 비서로 이용될 수 있습니다.

- the possibility of human-machine hybrid work. Instead of prompting an AI and hoping for a good result, humans can now guide AIs and correct mistakes. (Despite what my AI writing partner claims above, it’s not always accurate.) This means experts will be able to fill in the gaps of the AI’s capability, even as the AI becomes more helpful to the expert.

- A writer can easily edit badly written sentences that may appear in AI articles, a human programmer can spot errors in AI code, and an analyst can check the results of AI conclusions. This leads us, ultimately, to why this is so disruptive. The writer no longer needs to write the articles alone, the programmer to code on their own, or the analyst to approach the data themselves. The work is a new kind of collaboration that did not exist last month.

4. ChatGPT는 콘텐츠를 모으거나 다른 유저들을 충분히 끌어들이지 않아도 그 자체로 개개인 맞춤형 콘텐츠를 생성할 수 있다는 점에서 빠르게 성장하기에 유리했습니다.

- 다른 온라인 서비스와의 차별점

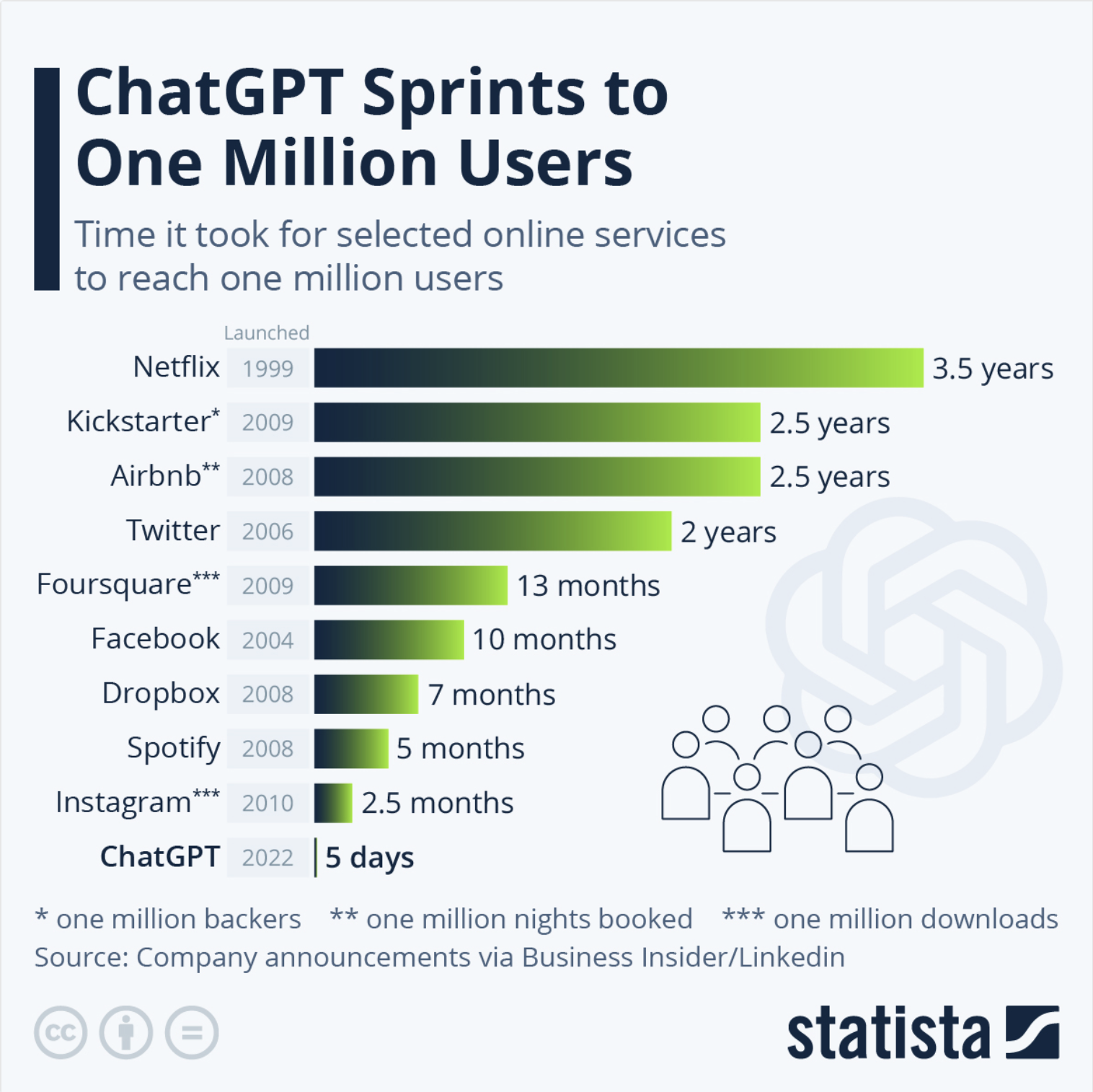

이번에는 ChatGPT가 다른 온라인 서비스와 비교해 빠르게 성장할 수 있었던 이유에 대해 분석해보겠습니다. ChatGPT는 콘텐츠를 미리 수급해두거나, 콘텐츠 공급자를 섭외하여 플랫폼을 이용하도록 만드는 등의 노력 없이 그 자체로 콘텐츠를 무한 생성해낼 수 있는 서비스라는 점에서 빠르게 성장하기에 유리했습니다. 꾸준히 좋은 콘텐츠가 자리잡도록 하는 노력도 필요가 없고, 다른 유저들을 많이 모아야 콘텐츠가 만들어지는 것도 아닙니다. 출시 이후 별다른 콘텐츠를 모으는 작업이 없이도 개개인이 자신의 취향, 입맛에 맞춰진 콘텐츠를 이용할 수 있습니다.

(아래 사진에 나온 서비스들만 봐도 콘텐츠를 모으거나 유저를 잔뜩 모아두어야 서비스를 이용할 이유가 생깁니다.)

요약 정리

앞에서 이야기한 내용 전체를 요약해보겠습니다. (요약은 ChatGPT에게 맡겨보았습니다.)

1. ChatGPT는 GPT-3에 RLHF를 적용하고 대화 데이터셋을 학습시켜 더 인간답고 자연스러운 답변을 내보낼 수 있다는 점에서 GPT-3와 구분됩니다.

ChatGPT는 GPT-3를 기반으로 하지만, 유저와의 ‘대화’에 특화된 언어 모델입니다. ChatGPT는 GPT-3.5를 기반으로 하며, RLHF(Reinforcement Learning from Human Feedback)를 이용해 학습됩니다. 이 방법은 fine tuning 시에 사람의 피드백을 이용하여 더 인간다운, 즉 자연스러운 답변을 생성할 수 있는 것입니다. ChatGPT는 InstructGPT와 같은 기술이지만, 채팅 기능을 더 강화시켜 서비스화한 것으로 알려져 있습니다.

2. ChatGPT는 안전성 문제와 논란에 관한 우려에 불구하고 과감하게 일반 대중을 대상으로 출시되었기에 성공할 수 있었습니다.

ChatGPT는 일반 대중을 대상으로 개발된 채팅 웹사이트로, 사용하기 쉽도록 만들어졌습니다. 반면, Google과 Meta와 같은 대형 기업들은 Safety Issue를 우려하여 일반 대중을 대상으로 하는 과감한 대화형 언어 모델을 출시하지 못했습니다. 특히, Google은 LaMDA를 AI 개발자들에게만 공개하고 있습니다. Meta의 Blenderbot은 안전성을 우선시해 사용자가 종교 등에 대해 물어봤을 때 주제를 바꾸도록 지시하는 등의 조치를 취하고 있습니다. 반면, ChatGPT는 Safety Issue를 꽤 잘 차단하면서도 흥미로운 대화를 제공하여 성공한 것으로 평가됩니다.

3. ChatGPT는 대화를 주고받는 챗봇 기능뿐 아니라, 누구나 새로운 콘텐츠(텍스트 형태)를 생성할 수 있는 창작 툴로서의 기능을 강조한 덕분에 논란을 피하고 다양한 사용자층을 끌어들일 수 있었습니다.

ChatGPT는 텍스트 생성 모델로, 자연어 대화에서 단순한 질문 답변을 넘어 새로운 콘텐츠를 창작하는데 사용됩니다. OpenAI는 ChatGPT를 일반 대중이 다양한 분야에서 사용할 수 있는 툴로 홍보하면서, 이에 대한 Safety 논란을 피하기 좋았습니다. 따라서 전문 지식을 필요로 하는 분야가 아니라 일반 대중을 대상으로 한 것이 이점이 되었습니다.

4. ChatGPT는 콘텐츠를 모으거나 다른 유저들을 충분히 끌어들이지 않아도 그 자체로 개개인 맞춤형 콘텐츠를 생성할 수 있다는 점에서 빠르게 성장하기에 유리했습니다.

ChatGPT는 다른 온라인 서비스와 비교했을 때, 콘텐츠를 미리 수급하거나 콘텐츠 공급자를 섭외하여 플랫폼을 이용하도록 만들지 않아도 된다는 점에서 빠르게 성장할 수 있었습니다. 이 서비스는 자체적으로 콘텐츠를 생성해냄으로써 꾸준히 좋은 콘텐츠를 모으는 노력이 필요하지 않으며, 다른 유저들을 많이 모아야만 콘텐츠를 만들어내는 것도 아닙니다. 개개인이 자신의 취향에 맞는 콘텐츠를 이용할 수 있기 때문입니다. 다른 온라인 서비스들은 콘텐츠를 모으거나 많은 유저를 모아야만 서비스를 이용할 이유가 생기는 반면, ChatGPT는 이러한 노력 없이도 빠르게 성장할 수 있었습니다.